吴恩达+OpenAI的教程总结(准则主要作用于ChatGPT,其他模型不一定适用)

一、Prompting的准则

准则1. 写一个清晰的和特别的指令

- 要点1. 使用特殊符号

- """

- ```

- ---

- <>

- <tag></tag>

- 要点2.要求结构化的输出

HTML,JSON - 要点3.检查条件是否被满足

check assumptions required to the task - 要点4.少样本prompting

准则2. 给模型思考的时间

- 要点1. 明确完成任务所需的步骤

step1、step2、step3、...stepN - 要点2. 指示模型去得到它自己的解答而不是急于给出一个结论

某些场景可以让LLM先自己给出方案/解答,然后再让它对比已有的(输出的)方案/解答,它会给出更好的比较。

模型局限性

需要考虑到模型的局限性,模型可能会给出似是而非但是实际上并不正确的回答(这种现象被称为'hallucinations')。降低hallucinations的方法:

- 找到相关信息

- 根据相信信息回答问题

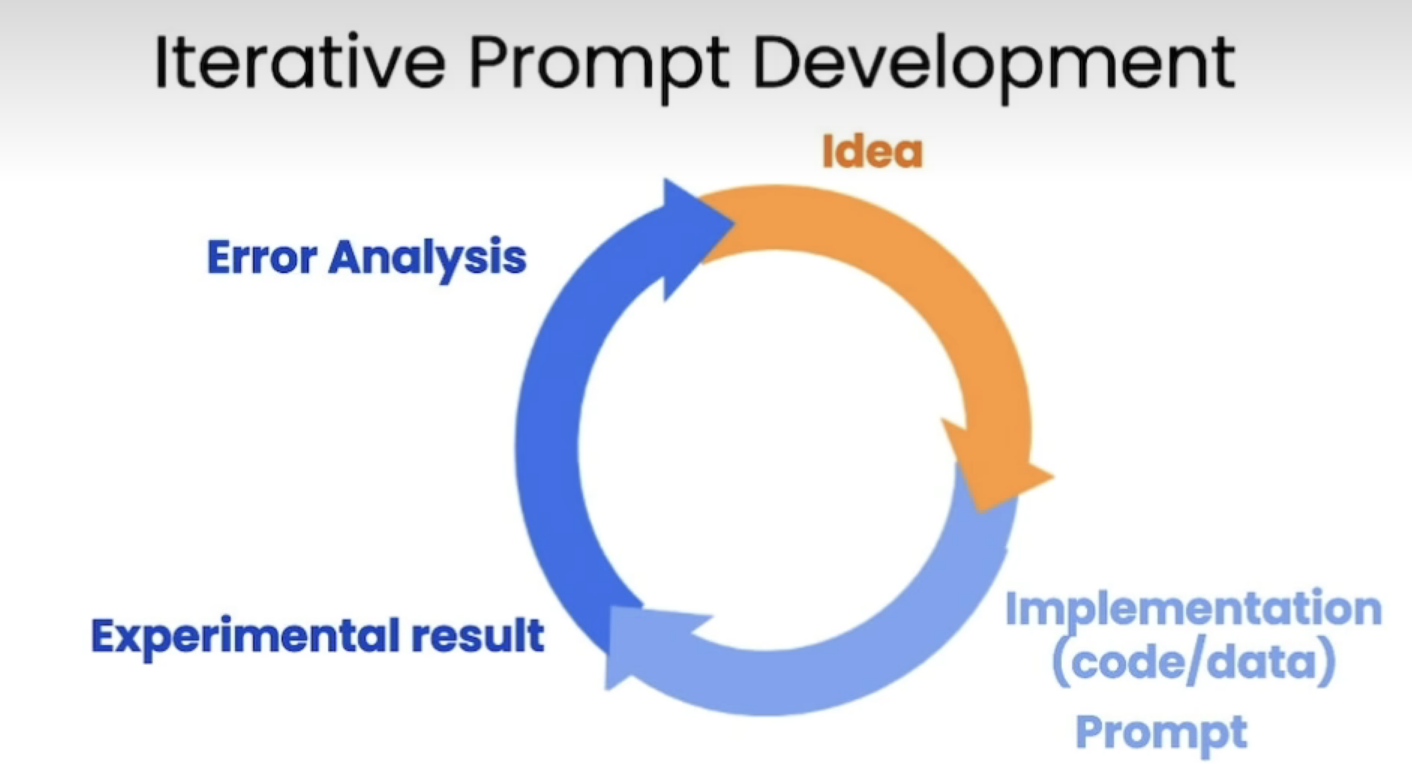

二、迭代式的提示工程开发

合适的提示词/框架需要通过迭代的方法去实现,就像传统ML的训练调参过程一样:

- 初始化,随便尝试某个指令

- 分析得到的结果和你内心想要的结果的差异

- 多花时间时间思考,更新指令,使其更清晰明了

- 使用一系列例子来细化提示